Agenten-KI 2026: Ein Leitfaden für Führungskräfte

Entdecken Sie, wie autonome KI-Agenten Unternehmen bis 2026 revolutionieren. Erfahren Sie mehr über Workflow-Orchestrierung, wirtschaftliche Auswirkungen und G…

Die Diskussion über künstliche Intelligenz in Unternehmen erlebt einen seismischen Wandel. Jahrelang lag der Fokus auf generativen Assistenten – hochentwickelten Chatbots, die E-Mails schreiben oder Berichte zusammenfassen konnten. Doch der wahre Paradigmenwechsel, auf den sich Führungskräfte bis 2026 vorbereiten müssen, ist der Aufstieg der Agenten-KI. Dies sind nicht nur Gesprächspartner; es sind autonome Akteure, digitale Mitarbeiter, die in der Lage sind, übergeordnete Ziele zu empfangen und komplexe, mehrstufige Arbeitsabläufe über verschiedene Systeme hinweg auszuführen. Mit der Weiterentwicklung der digitalen Schnittstellen an unseren Arbeitsplätzen gehen wir davon über, einer KI Befehle zu geben, hin zur Delegation ganzer Geschäftsprozesse.

Orchestrierung autonomer Workflows

Der Sprung von generativer zu agentenbasierter KI ist der Unterschied zwischen einem Werkzeug und einem Teammitglied. Ein generatives Modell reagiert auf eine Eingabeaufforderung. Ein agentenbasiertes System interpretiert ein Ziel. Betrachten Sie den im Workflow-Diagramm dargestellten Logistikprozess in der Lieferkette. Ein menschlicher Manager könnte ein einfaches Ziel vorgeben: „Führe diesen dringenden Auftrag für Kunde X aus.“ Der KI-Agent fragt nicht nach schrittweisen Anweisungen. Stattdessen initiiert er autonom eine Abfolge von Aktionen.

Zuerst fragt der Agent das interne ERP-System ab, um Lagerbestände und Bestelldetails zu bestätigen. Als Nächstes greift er auf die API eines externen Logistikdienstleisters zu, um die Verfügbarkeit und Preise von Spediteuren zu prüfen. Schließlich führt er eine Transaktion durch, um den optimalen Spediteur zu buchen, und aktualisiert alle relevanten Systeme in Echtzeit. Dieser gesamte Prozess, der einst stundenlange manuelle Koordination zwischen Abteilungen erforderte, wird in Sekunden ohne menschliches Eingreifen abgeschlossen. Das ist der Kern der Agenten-Architektur: schlussfolgern, Werkzeuge nutzen und autonom ausführen.

Prognostizierte Kennzahlen für Agenten-Workflows (2026)

Autonome Aufgaben-Erledigung

75%

Rate der Workflows, die ohne menschliches Eingreifen von Anfang bis Ende abgeschlossen werden.

Mittlere API-Latenz

2

Durchschnittszeit für den Agenten, um Daten von externen Systemen abzufragen und zu erhalten.

Reduzierung manueller Triage

85

Rückgang der Arbeitsstunden für die Bearbeitung von Ausnahmefällen und die Weiterleitung.

Jährliche OpEx-Einsparungen

4.2EUR

Prognostizierte Einsparungen pro Geschäftsbereich durch automatisierte Workflows.

Das wirtschaftliche Versprechen & Null-Grenzkosten-Transaktionen

%20(2).png)

Die wirtschaftlichen Auswirkungen der Agenten-KI sind tiefgreifend und resultieren aus dem nahezu vollständigen Zusammenbruch der Transaktionskosten für komplexe Informationsverarbeitung. In der traditionellen Wirtschaft ist jede Geschäftsaktion – die Suche nach einem Lieferanten, die Aushandlung eines Vertrags, die Überprüfung von Referenzen – mit Kosten in Form von Zeit, Aufwand und Ressourcen verbunden. Menschen sind durch kognitive Belastung, Aufmerksamkeitsspanne und die schiere Zeit für Kommunikation und Koordination begrenzt.

KI-Agenten beseitigen diese Einschränkungen. Sie können Tausende von Beschaffungsoptionen gleichzeitig bewerten, mit mehreren Anbieter-Bots nach vordefinierten Parametern verhandeln und verbindliche digitale Verträge in Maschinengeschwindigkeit abschließen. In hochsensiblen Bereichen wie Immobilienauktionen oder Finanzarbitrage kann ein Agent rund um die Uhr ohne Ermüdung arbeiten und Informationen in einem Umfang verarbeiten, den kein menschliches Team je erreichen könnte. Die Grenzkosten für die Ausführung einer weiteren komplexen Transaktion nähern sich Null, was Unternehmen ermöglicht, mit beispielloser Skalierbarkeit und Effizienz zu agieren.

Prognostizierte Adaption von Agenten-KI nach Sektor (2026)

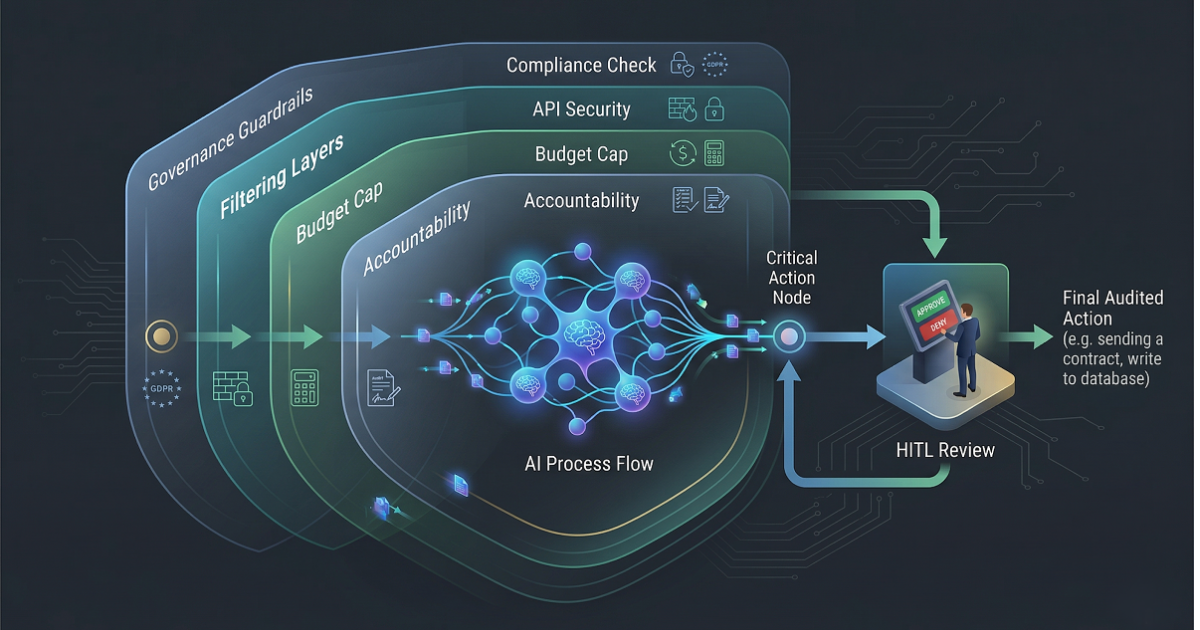

Die Notwendigkeit von Governance & Human-in-the-Loop

Einer KI Autonomie zu gewähren, ist keine Frage des Vertrauens, sondern eine Frage robuster Governance. Da Agenten die Fähigkeit erhalten, in unserem Namen zu handeln – insbesondere mit „Schreibzugriff“ auf APIs und Datenbanken – wird die Notwendigkeit programmatischer Leitplanken unverzichtbar. Ein ungeregelter Agent stellt eine inakzeptable Haftung dar. Hier ist ein strukturiertes, mehrschichtiges Human-in-the-Loop (HITL)-Framework für den Unternehmenseinsatz entscheidend.

Wie das Sicherheitsdiagramm veranschaulicht, muss jede vorgeschlagene Aktion eines KI-Agenten eine Reihe automatisierter Prüfungen durchlaufen, bevor sie ausgeführt werden kann. Diese Filter sind das Gewissen des Systems. Eine 'Compliance'-Schicht prüft die Einhaltung von Vorschriften wie der DSGVO. Eine 'API-Sicherheits'-Schicht validiert Anmeldeinformationen und Berechtigungen. Eine 'Budget'-Schicht verhindert finanzielle Überschreitungen. Eine 'Rechenschafts'-Schicht protokolliert jede Entscheidung für Audits. Erst nach Bestehen dieser Prüfungen wird die Aktion fortgesetzt. Bei den kritischsten Aktionen, wie einer großen Geldüberweisung oder einem wichtigen Datenbankschreibvorgang, hält der Prozess an einem 'Kritischen Aktionsknoten' an und erfordert die explizite Genehmigung durch einen benannten menschlichen Bediener an einem Terminal. Dies stellt sicher, dass Autonomie die menschliche Aufsicht verbessert, anstatt sie zu ersetzen.

Agenten-KI-Trichter für Cybersicherheitsbedrohungen

Implementierungsrealität & die 80-Prozent-Regel

Die Einführung von Agenten-KI ist keine einfache Softwareinstallation. Führungskräfte müssen die '80-Prozent-Regel' der Implementierung verstehen: 80 % des Aufwands liegen nicht in der Modelloptimierung oder dem Prompt-Engineering, sondern in der grundlegenden Arbeit des Data Engineering, der Prozessneugestaltung und der Abstimmung mit den Stakeholdern. Der fortschrittlichste KI-Agent ist nutzlos, wenn er an isolierte, unzuverlässige Datenquellen angebunden ist oder wenn seine vorgesehenen Benutzer seinen Ergebnissen nicht vertrauen.

Die eigentliche Arbeit besteht darin, Daten zu bereinigen und zu strukturieren, robuste APIs für Altsysteme zu erstellen und bestehende menschliche Arbeitsabläufe sorgfältig zu analysieren, um Automatisierungsmöglichkeiten zu identifizieren. Dies erfordert eine enge Zusammenarbeit zwischen IT, Data Science und den Geschäftsbereichen, um die Ziele, Einschränkungen und Eskalationspfade des Agenten zu definieren. Darüber hinaus wird erheblicher Aufwand in die Gestaltung der 'Persönlichkeit' und des Kommunikationsstils des Agenten investiert, um sicherzustellen, dass er sich reibungslos in menschliche Teams integriert und klare Begründungen für seine Entscheidungen liefert, anstatt als undurchsichtige Blackbox zu agieren.

Generative Copilots vs. Agenten-KI

| Feature | Generative Copilots (2023) | Agenten-KI (2026)Best |

|---|---|---|

| Ausführungsfähigkeiten | ||

| API-Schreibzugriff | ||

| Aufsichtsanforderungen | ||

| Mehrstufige Planung |

""In der nächsten Produktivitätsära geht es nicht darum, mit einer KI zu chatten. Es geht darum, Ergebnisse an eine KI zu delegieren und ihr die Ausführung des Prozesses anzuvertrauen."

Die 3 Säulen des Agenten-Risikos

Obwohl das Potenzial enorm ist, sind die mit Agenten-KI verbundenen Risiken ebenso signifikant und müssen proaktiv gemanagt werden. Führungskräfte müssen ihre Strategie auf drei zentralen Säulen der Risikominderung aufbauen.

- Unregelmäßige Zuverlässigkeit & fehlerhafte Logik: Agenten-Modelle können manchmal auf unvorhersehbare Weise versagen. Ein Agent für die Kreditwürdigkeitsprüfung könnte ein fehlerhaftes Logikmuster entwickeln und beginnen, qualifizierte Kreditantragsteller abzulehnen, was zu finanziellen und reputativen Schäden führt. Kontinuierliche Modellüberwachung und Leistungsvalidierung sind unerlässlich, um diese 'Edge-Case'-Fehler zu erkennen, bevor sie sich ausweiten.

- Erweiterte Angriffsfläche für Cybersicherheit: Einer KI 'Schreibzugriff' auf Ihre Kernsysteme zu gewähren, schafft einen potenten neuen Angriffsvektor. Wenn die Anmeldeinformationen eines Agenten kompromittiert werden, könnte ein Angreifer ihm befehlen, Daten zu exfiltrieren, den Betrieb zu stören oder betrügerische Transaktionen einzuleiten. Zero-Trust-Architektur und strenges Identitätsmanagement für KI-Agenten sind von größter Bedeutung.

- Rechenschafts-Frameworks: Wenn ein autonomer Agent einen Fehler macht, wer ist verantwortlich? Der Entwickler? Der Datenanbieter? Der Benutzer, der das Ziel zugewiesen hat? Klare Rechenschafts-Frameworks müssen vor der Bereitstellung etabliert werden, die die Haftung definieren und Verfahren zur Behebung festlegen. Dies ist ebenso eine rechtliche und ethische Herausforderung wie eine technische.

Risiko von Kaskadeneffekten

Ein einziger fehlerhafter Agent, der in mehrere Arbeitsabläufe integriert ist, kann Kaskadenfehler im gesamten Unternehmen verursachen. Isolieren Sie kritische Systeme und implementieren Sie Schutzschalter-Mechanismen, um potenziellen Schaden einzudämmen.

Letztendlich ist die Überwachung keine einmalige Einrichtung, sondern ein permanenter Betriebskostenfaktor. Das Unternehmen des Jahres 2026 wird mit einer hybriden Belegschaft aus Menschen und KI-Agenten arbeiten. Genauso wie Sie Ihre menschlichen Mitarbeiter führen, müssen Sie Ihre digitalen Mitarbeiter kontinuierlich managen, überwachen und steuern, um ihr volles Potenzial sicher auszuschöpfen.

Ist Ihr Unternehmen bereit für Agenten-KI?

Die Zukunft der autonomen Betriebsabläufe ist da. Kontaktieren Sie unser Strategieteam, um Ihre Roadmap für 2026 und darüber hinaus zu entwickeln.

Strategiesitzung buchen